Editorial: Künstliche Intelligenz und immer mehr Cloud

EDITORIAL:VIDEOAKTIV-Magazin Editorial: Februar 2023

EDITORIAL:VIDEOAKTIV-Magazin Editorial: Februar 2023

Die Kamera hat keinen gewöhnlichen Autofokus mehr, sondern dieser wurde anhand von „Künstlicher Intelligenz“ verfeinert. Lernt die Kamera nun also dazu und wird der Autofokus bei der Erkennung, was scharf sein soll, immer besser? Klingt gut – aber was lernt eine Kamera, die nicht in Händen von begabten Filmschaffenden landet? Stellt diese dann irgendwann gar nicht mehr scharf? OK, das ist etwas überspitzt und tatsächlich ist ja nur gemeint, dass man den Algorithmus des Autofokus anhand einer Analyse von vielen Bildern verbessert hat. Übrigens macht man das schon seit einiger Zeit so – der Unterschied ist nur, dass nun in kürzerer Zeit mehr Bilder automatisch analysieren werden können.

Panasonic, aber auch Canon, Sony und Fujifilm, haben bei den neuen AF-Funktionen zur Personen- und Objekt-Erkennung auf KI-Technologie zurückgegriffen. Am Ende steht aber dennoch ein Mensch hinter der Kamera. Die Kamera selbst hat noch keine KI.

Berührungen mit der Künstlichen Intelligenz haben die meisten ja schon, denn Siri (Apple) und Alexa (Amazon) arbeiten schon länger in unserem direkten Umfeld. In der Realität fordert der Einsatz von künstlicher Intelligenz weit höhere Rechenleistung als eine Kamera bieten kann. Selbst Smartphones und Rechner übertragen die jeweiligen Anfragen auf Server im Internet – unter anderem deshalb weil die „künstliche Intelligenz“ natürlich mit Wissen gefüttert sein will. Ohne passende Datenfütterung wird der Autofokus nicht besser und die Unterhaltung mit dem Computer bleibt stockend.

Hypotenuse AI generiert auf die Anforderung „data save in cloud“ dieses Bild, das wir dann mit Photoshop aus dem 4:3 ins 16:9-Format „verlängert“ haben. Wer eine höhere Auflösung will, muss sich ein Abo für 29 US-Dollar im Monat gönnen.

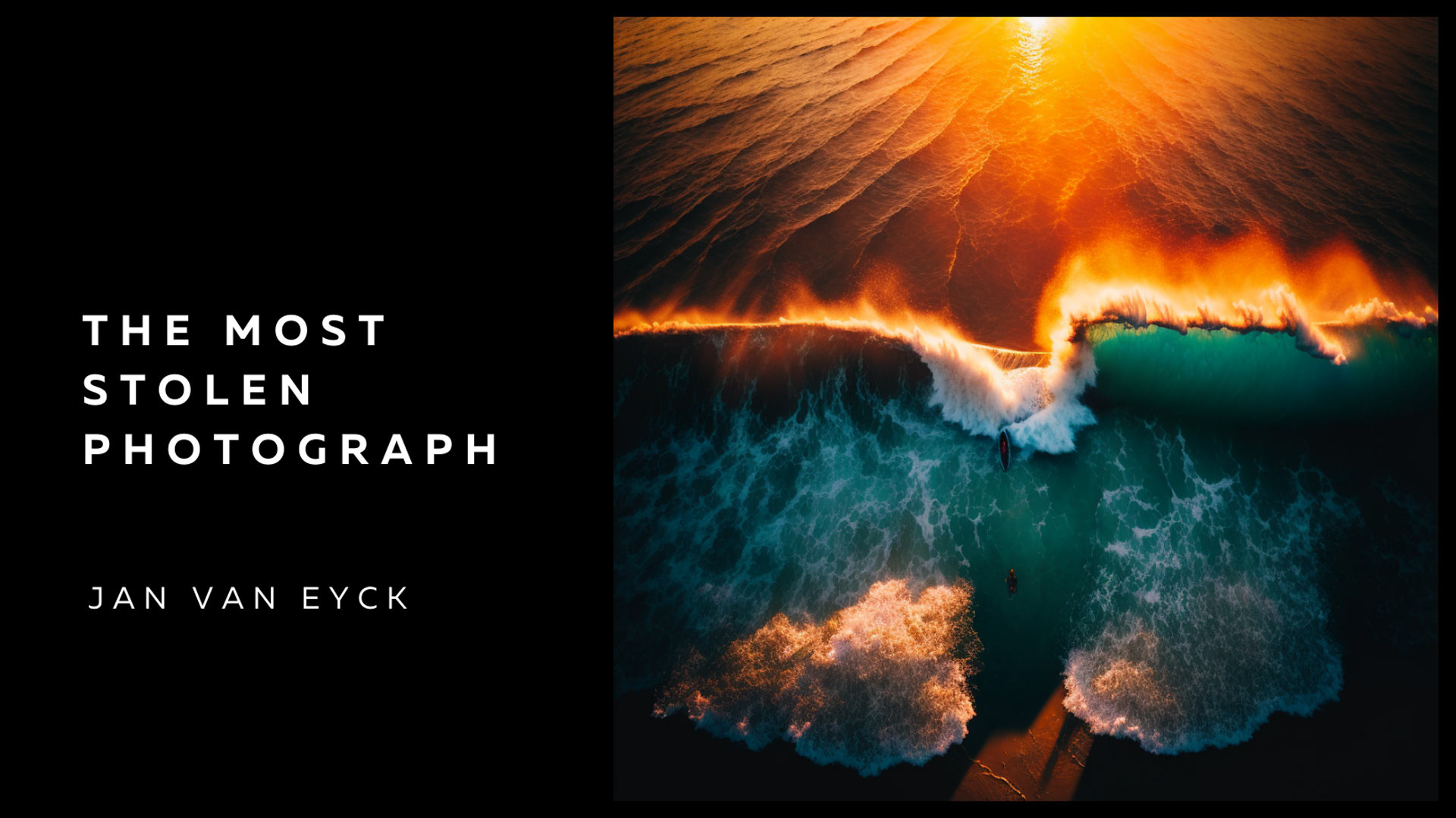

Warum rückt also die Künstliche Intelligenz und im speziellen ChatGPT auf einmal so in den Fokus? Es ist, wie immer bei einem Hype, schwer zu ermitteln, doch der triftigste Grund dürfte sein, dass ChatGPT besser beim Aufbereiten des gesammelten Wissens ist und eine bemerkenswert gute Sprache hat, die selbst unsere Vielschreiber in der Redaktion zum Nachdenken bringt. Und in Australien haben die Macher von Absolutely AI unter Pseudonym bei einem Fotowettbewerb ein berechnetes Bild eingereicht und damit den Wettbewerb gewonnen. Auf gut Deutsch: Der Fortschritt der KI (oder auch AI für Artifical Intelligence) ist groß, dass wird nun klar: Sie kann die Arbeit von Menschen ersetzen. Inhalte können künftig einfacher, schneller und günstiger erstellt werden, egal ob es sich dabei um Texte, Bilder oder Videos handelt. Ob wir das gut finden oder nicht – aufhalten werden wir es nicht.

Mit diesem durch eine KI-Anwendung generierten und per Pseudonym eingereichten Bild überzeugten die Macher von Absolutely AI die Jury von DigiDirect in Australien. Nach dem Gewinn haben die KI-Macher die künstliche Generierung offengelegt und auf das ausgelobte Preisgeld verzichtet.

Doch (zumindest derzeit) greifen die verschiedenen KI-Ansätze auf Wissen zurück, das von Menschen erarbeitet wurde und noch müssen wir die passenden Fragen stellen, damit am Ende sinnvolle Texte, Bilder und Videos entstehen. Für die Bildauswahl dieses Editorials haben wir ca. 30 Anfragen an Hypotenuse AI geschickt. Erst als wir gelernt hatten, wie die Fragestellung aussehen muss und was die jeweilige KI benötigt, haben wir brauchbare Bilder und Texte erhalten.

Etwas Übung benötigt man derzeit noch um dem Rechner eine Anforderung zu stellen, aus der er ordentliche Bilder generieren kann.

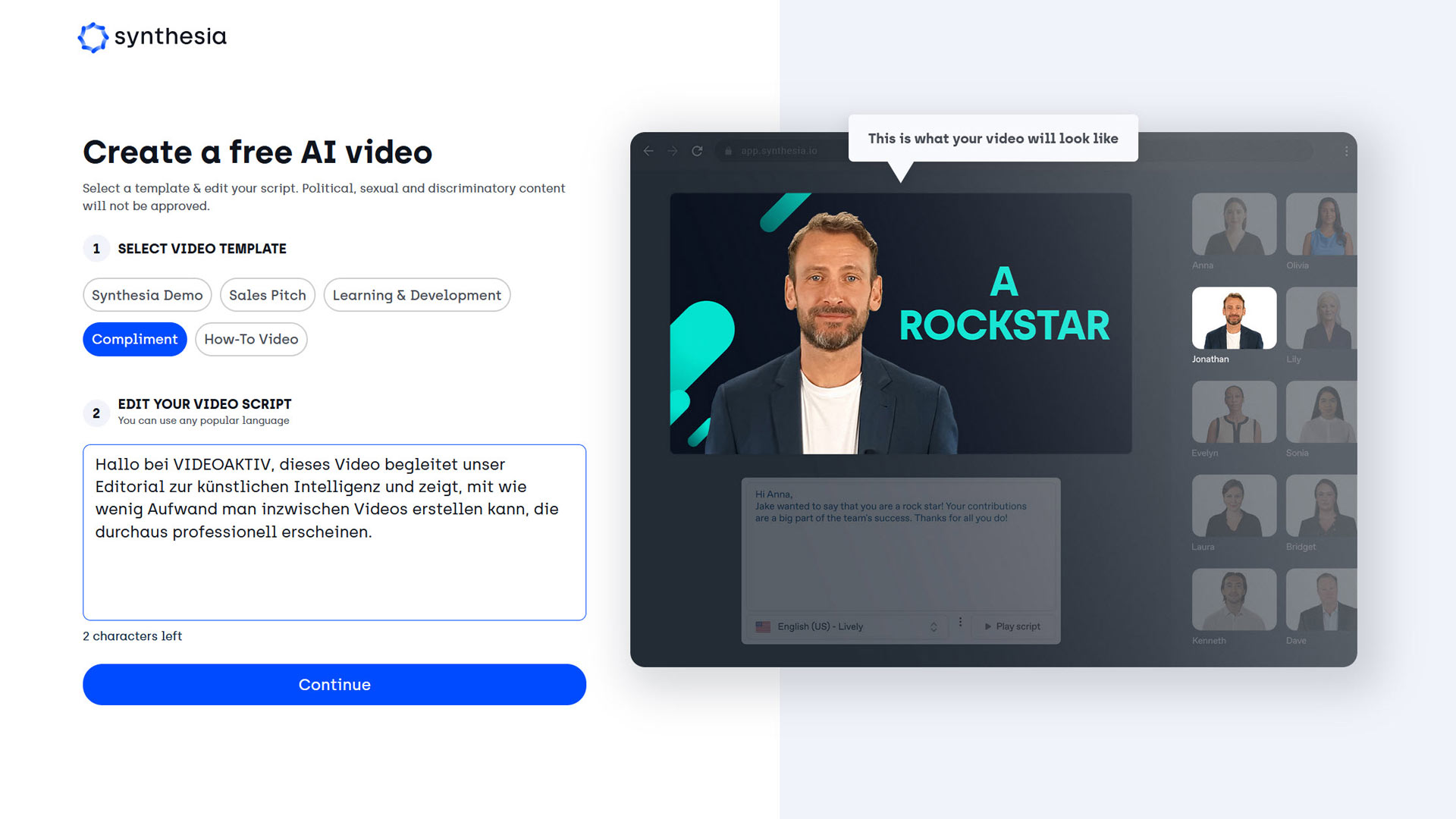

Beim bewegten Bild ist das noch anders: Hier muss man neben der Idee zum Bild auch noch den passenden Text liefern. Vollautomatisch auf eine Fragestellung ein Video aus Text und passendem Bild erstellen – soweit ist die Technik derzeit noch nicht. Es gibt verschiedene Ansätze, wobei Synthesia bereits mit einer praxisgerechten Anwendung überzeugt: Aus vorgefertigten Moderatoren wählt man das passende „Modell“ fügt die passenden Schlagworte für die im Hintergrund ablaufende Präsentation hinzu und liefert den zu moderierenden Text.

In der kostenfreien Testversion bekommt man nach dem Zufallsprinzip beziehungsweise dem ausgewählten Themen-Preset eine Moderatorin oder Moderator vorgesetzt und die Länge des Moderationstexts ist sehr begrenzt.

Die KI von Synthesia sorgt dafür, dass nun alles zusammenläuft und sich der Mund der wahlweise weiblichen oder männlichen Moderatoren bewegt. Lippen-Synchronität ist dabei nur ansatzweise gegeben – doch durch die vielen schlecht übersetzten Spielfilme fällt das wahrscheinlich vielen gar nicht auf. Und genau deshalb ist es durchaus denkbar, dass einige Firmen dieses Werkzeug für kurze firmeninterne Schulungen durchaus attraktiv finden. Immerhin hat der Mitarbeiter so einen persönlichen Bezug – zumal man sich vorstellen kann, dass hier künftig bekannte Persönlichkeiten oder der eigene Firmenchef Pate für das entsprechende Avatar steht.

Die deutsche Sprache setzt die KI besser um als die meisten Navigationssysteme, die zwar auch eine automatisierte Sprachausgabe haben, aber eher auf Textschnipsel zurückgreifen. Die Machart ist zumindest für kurze Anleitungen durchaus eine Option.

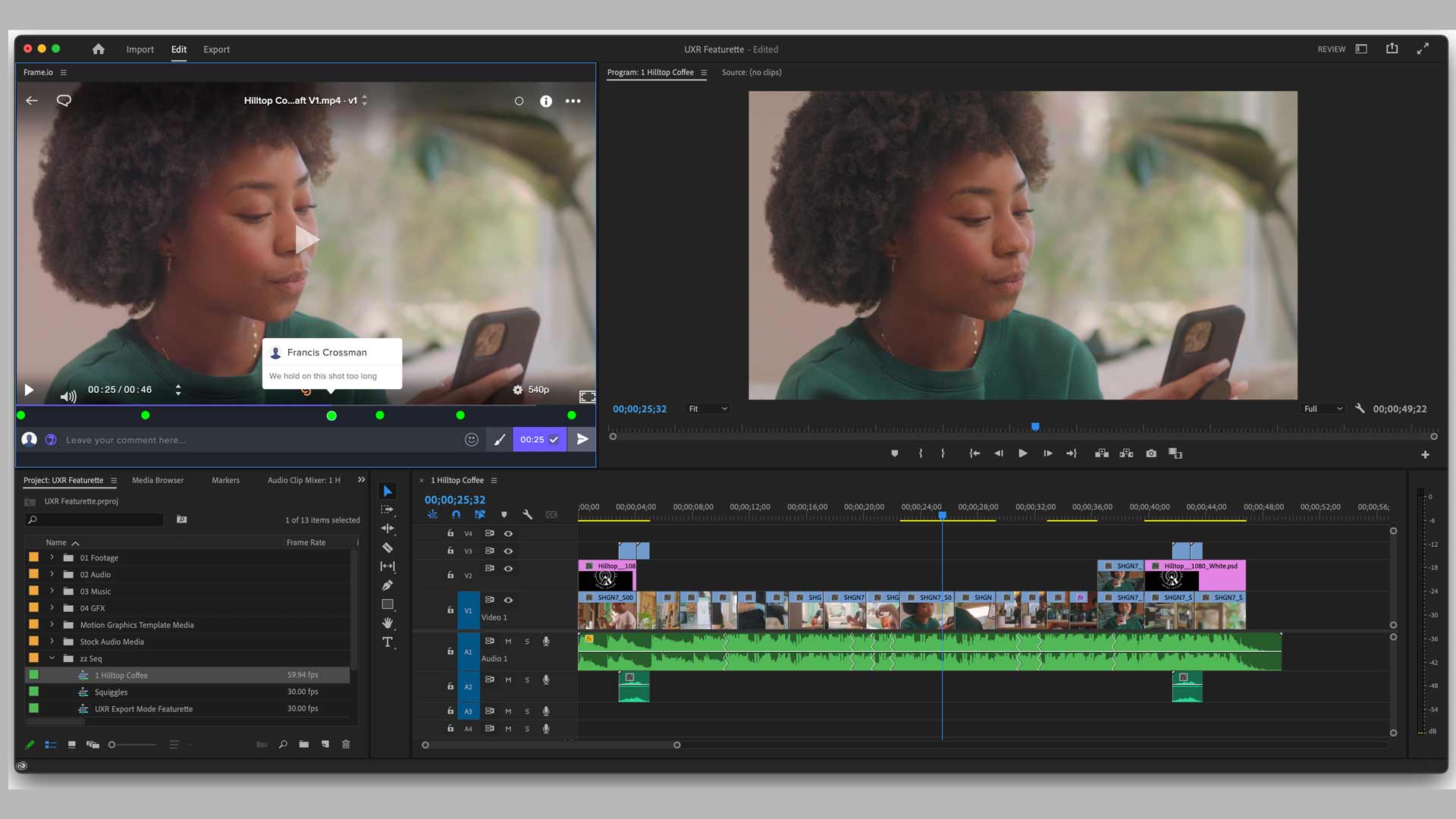

Auf den ersten Blick erkennt man es vielleicht nicht, doch tatsächlich gibt es einen direkten Zusammenhang mit dem weiteren Trend „Camera-to-Cloud“. Denn wie gesagt: Derzeit findet bei nahezu allen Anwendungen die Analyse der Ki auf Servern im Netz statt. Liegen die Videos also schon mal in der Cloud, kann man diese auch analysieren. Dazu gehören im ersten Schritt die Metadaten, so dass man Videos leichter sortieren kann, aber die Bildanalyse wird kommen. Immerhin gibt es schon seit Jahrzehnten automatische Schnittwerkzeuge, die nach einer Bildanalyse und entsprechenden Vorlagen kurze Videoclips erstellen können. Heute würde man diese Algorithmen ganz trendig als KI bezeichnen. Der Haken war: Sie haben nicht dazu gelernt, sondern haben immer den gleichen Algorithmus verwendet. Das ist witzig für die ersten Videos, wird aber schnell langweilig. Genau das ist der Grund, warum derzeit alle KI-Anwendungen auf die Cloud setzen.

F

Das letzte Wort behält dieses Mal die KI, deshalb greifen wir hier mal vor und resümieren: Die KI steckt noch in den Kinderschuhen, doch bekanntlich wachsen Kinderfüße besonders schnell. Man sollte also besser nicht die Augen davor verschließen, dass hier Werkzeuge kommen, die viele Tätigkeiten im Medienbereich einfacher und schneller machen. Mal eben eine Grafik, ein kurzer Text für Social Media (den eh nur die wenigsten lesen) – kein Problem, das bekommt man mit KI hin.

Auch Sony will künftig Daten am liebsten gar nicht mehr in der Kamera speichern, sondern direkt in die Cloud schicken, wo sich die Daten sortieren lassen – natürlich künftig automatisch ohne unser Zutun. Originalzitat: „Sony möchte erreichen, dass Kreative cloudbasierte Anwendungen als elementare Tools betrachten, genau wie die Kameras, die für Ihre Arbeit unverzichtbar sind. Die Möglichkeiten der Cloud lassen die Grenzen zwischen Hardware und Software, online und offline zunehmend verschwimmen.“ Auch einen Vorschnitt kann man in der Creators